昨天 Meta Connect 2024 Meta 全线内容都获得了更新,核心是 AI 和 AR 两个部分,看来小扎希望从这两个部分一个软一个硬来抢摊下个时代的平台级入口。

从发布会来看可能确实走对了,尤其是世界上最先进的 AR 眼镜 “Orion” 解决了虚拟现实设备几个重要的问题。

下面是 Meta 主要的发布内容:

- 发布 Llama 3.2 系列模型

- Meta AI 以及其他软件获得更多 AI 能力加持

- 概念 AR 眼镜 Orion 以及 Quest 3S 还有雷朋 Meta 太阳镜

模型

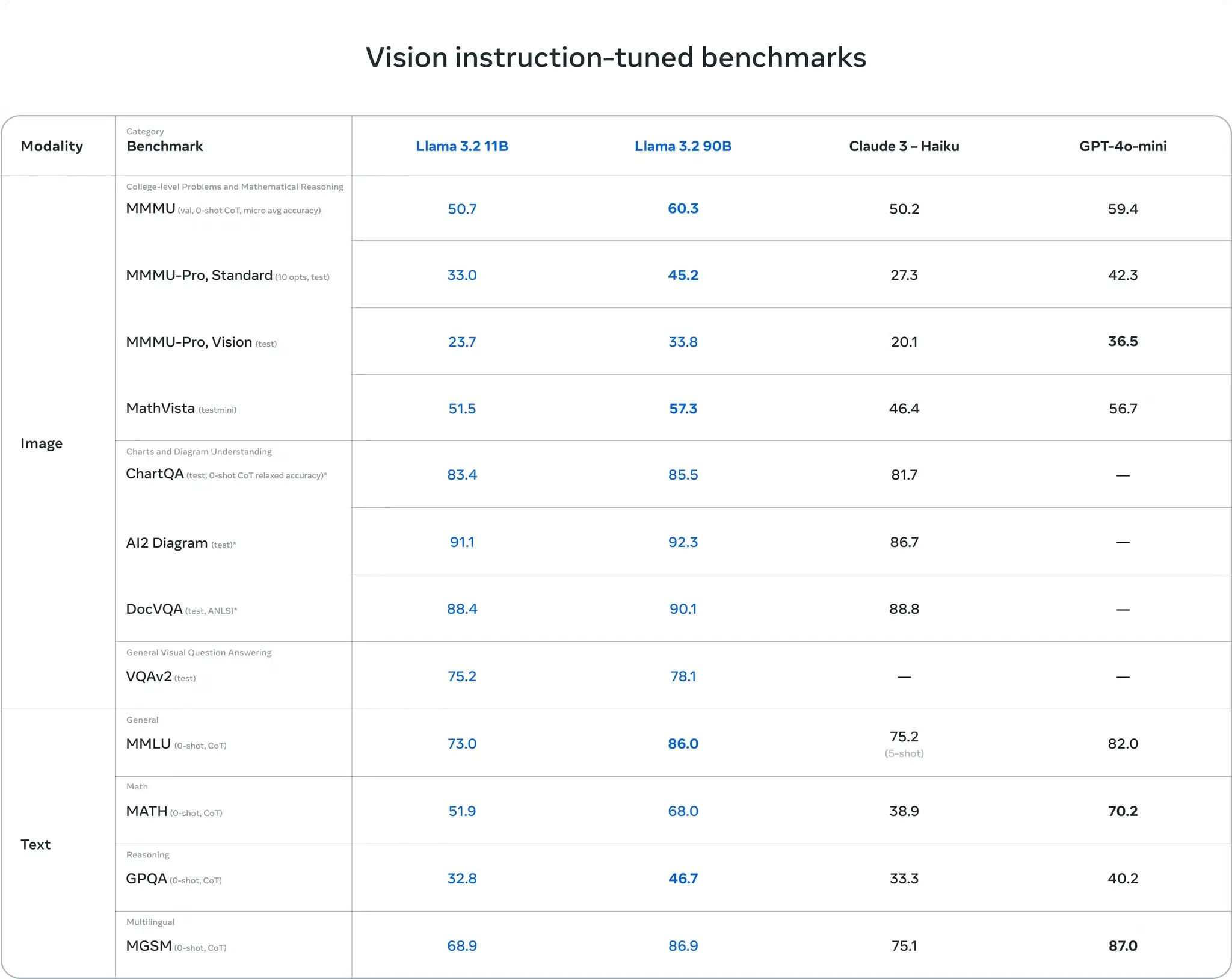

主要发布了四个模型 Llama 3.2 11B 和 90B 两个多模态 LLM,还有 1B 和 3B 两个小型语言模型:

- 11B 和 90B,支持图像推理用例,例如文档级理解,包括图表和图形、图像的描述以及视觉定位任务。

- Llama 3.2 视觉模型在图像识别和视觉理解任务中与 Claude 3 Haiku 和 GPT4o-mini 比都具有竞争力。

- Llama 3.2 1B 和 3B 支持 128K Token的上下文,并在移动设备常见任务比如摘要、总结、指令遵循上都很强,同时针对 Arm 处理器进行了优化。

- 发布Llama Stack 发行版,集成了单节点、本地、云和设备,支持即插即用的 RAG 和工具启用的应用程序。

**Daniel Han 关于 Llama3.2 模型核心优化点的一些总结:**

- 10 亿参数和 30 亿参数模型使用了部分来自 80 亿参数和 700 亿参数模型的知识蒸馏 (distillation) 技术。

- 视觉语言模型 (Vision Language Model, VLM) 使用了 60 亿个图像-文本对进行训练。

- 采用了 CLIP 式 MLP 结构,使用 GeLU 激活函数和交叉注意力机制。

- 视觉编码器中使用了类似 CLIP 的 MLP 结构,采用 GeLU 激活函数。这与 GPT2 的 MLP 结构相似,但与 Llama 3 不同,因为视觉 MLP 没有使用 SwiGLU。

- 视觉编码器使用了标准的层归一化 (Layer Normalization),而非 RMS 层归一化。此外,还引入了一个"门控"参数来调节隐藏状态。

- 在注意力层和 MLP 层之后,使用门控机制对隐藏状态进行调节。采用 tanh 函数将向量缩放到 -1 到 1 之间。

- 评估结果显示,小型 LLM (10 亿和 30 亿参数) 和多模态 VLM (110 亿和 900 亿参数) 的性能都相当不错。10 亿参数模型在 MMLU (Massive Multitask Language Understanding) 测试中得分 49.3,30 亿参数模型得分 63.4。VLM 在 MMMU (Massive Multitask Multimodal Understanding) 测试中,110 亿参数模型得分 50.7,900 亿参数模型得分 60.3。

模型下载:

https://huggingface.co/meta-llama

模型体验:

https://ollama.com/blog/llama3.2

https://console.groq.com/playground

软件

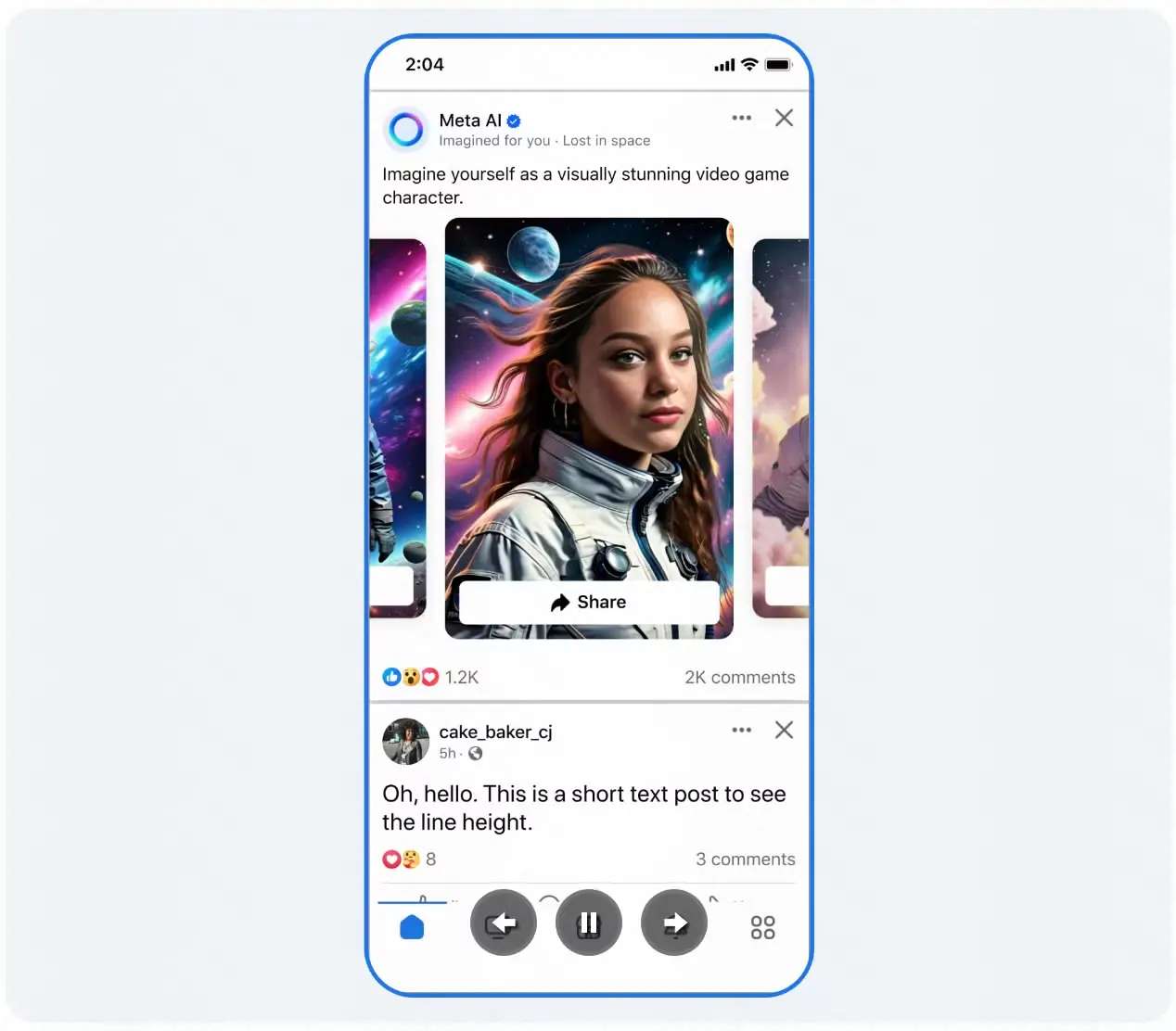

软件层面的更新也很多出了 Meta AI 这个专门的 AI 之外,Meta 也开始往信息流中插入 AI 生成的内容,可能是第一个主动做这件事的大厂,属实很激进。

用户可以通过 Messenger、Facebook、WhatsApp 和 Instagram 和 Meta AI 进行语音聊天,同时可以切换很多名人的声音。

现在正在测试在Facebook 和 Instagram 动态中自动推送 AI 生成的内容,Meta AI 专为你创建的图像(基于兴趣或当前趋势),可以滑动更改内容。

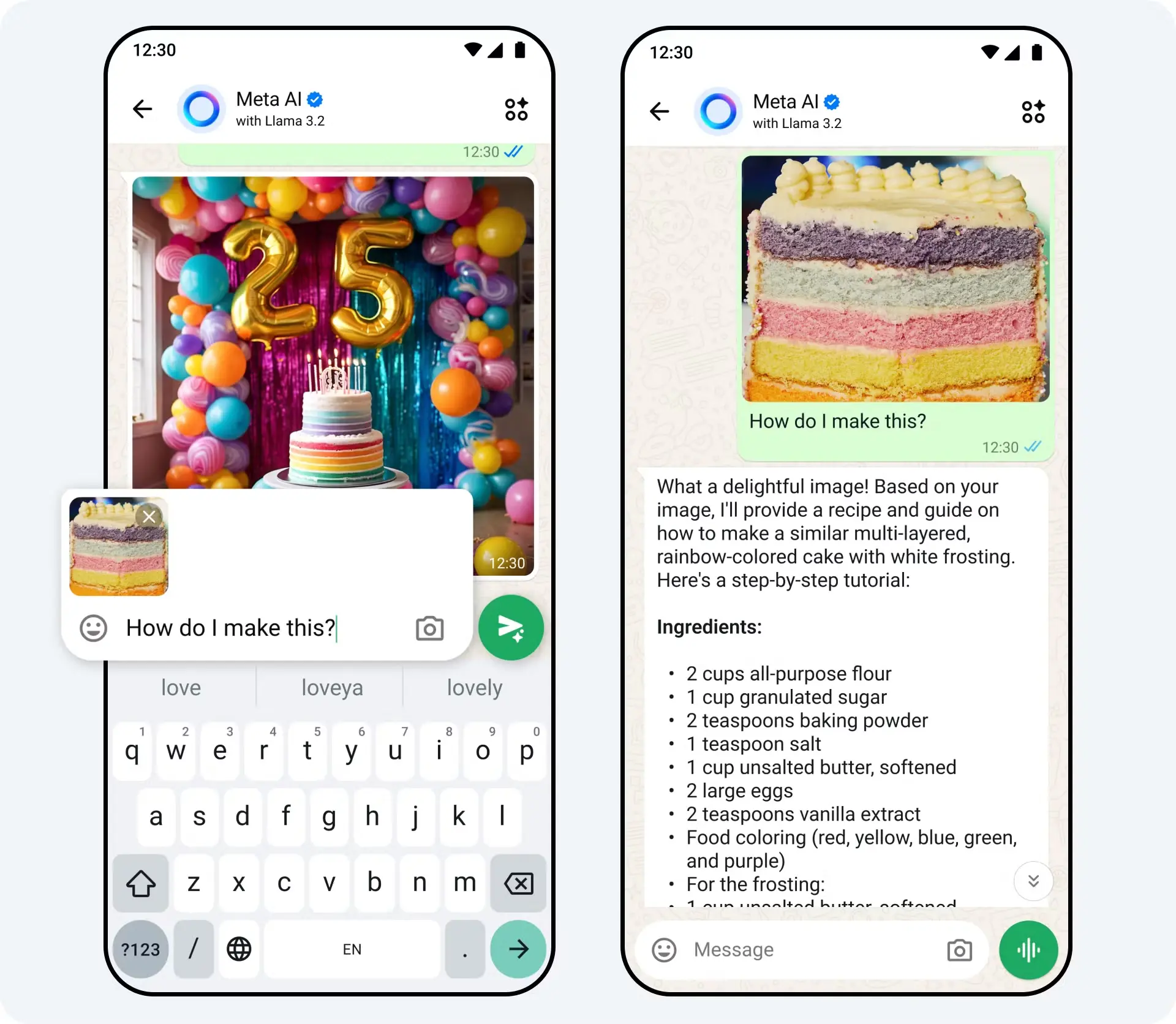

Meta AI 现在还可以获取图片的信息,之后还可以通过文本提示对已有的图片进行局部编辑。

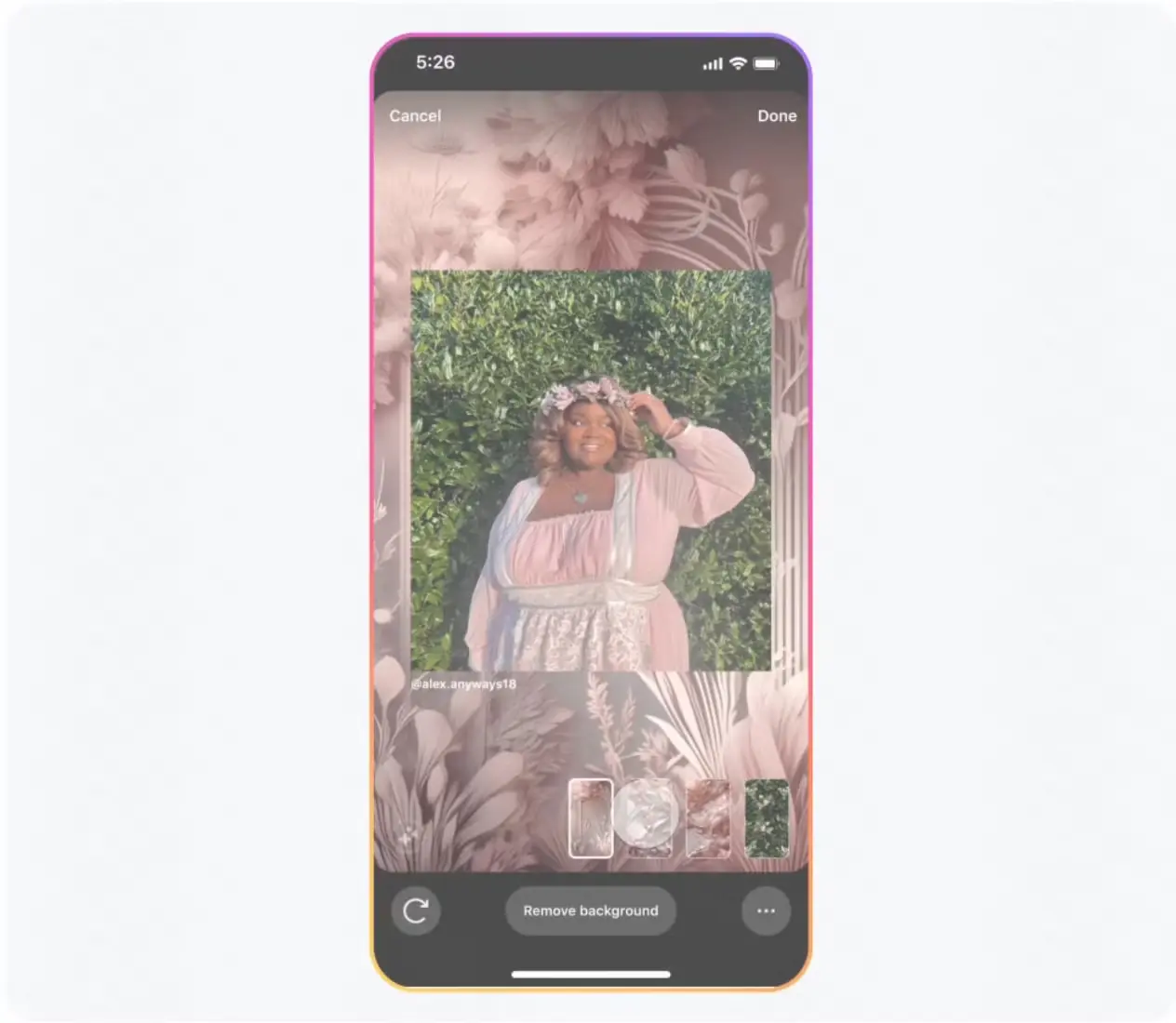

如果将你已有的图片分享到Instagram Story的时候,Meta AI 还会主动为照片生成背景。

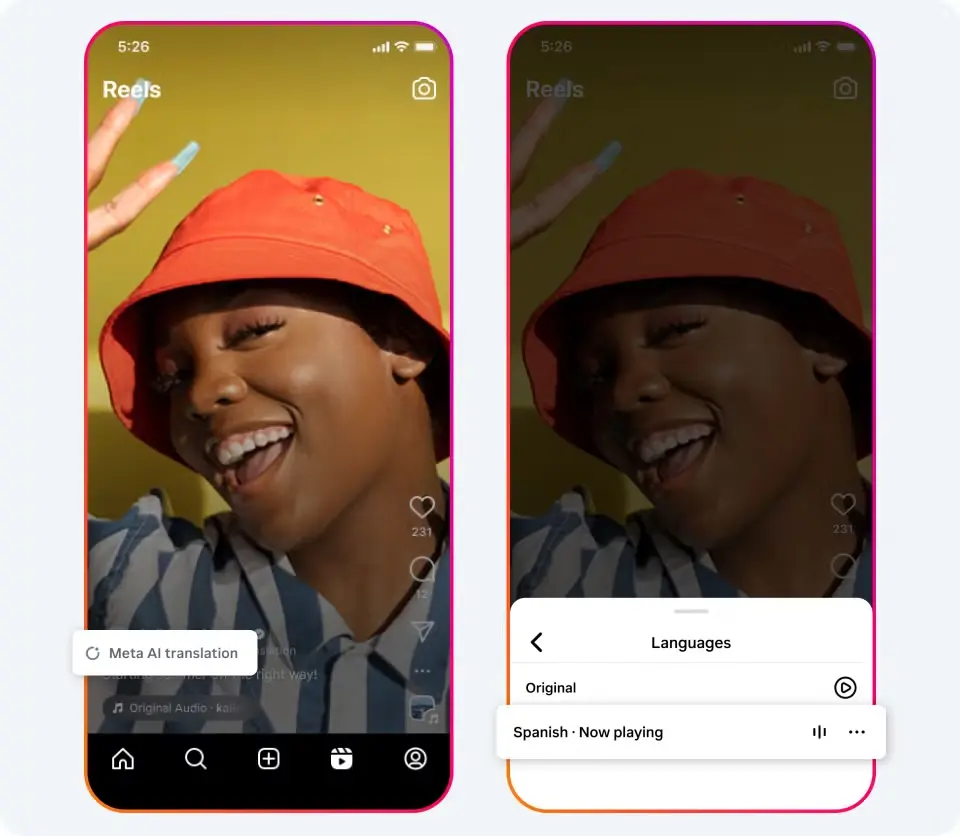

Meta AI 翻译工具:可以自动翻译 Reels 的音频,支持增加口型同步。目前支持英语和西班牙语互相翻译。

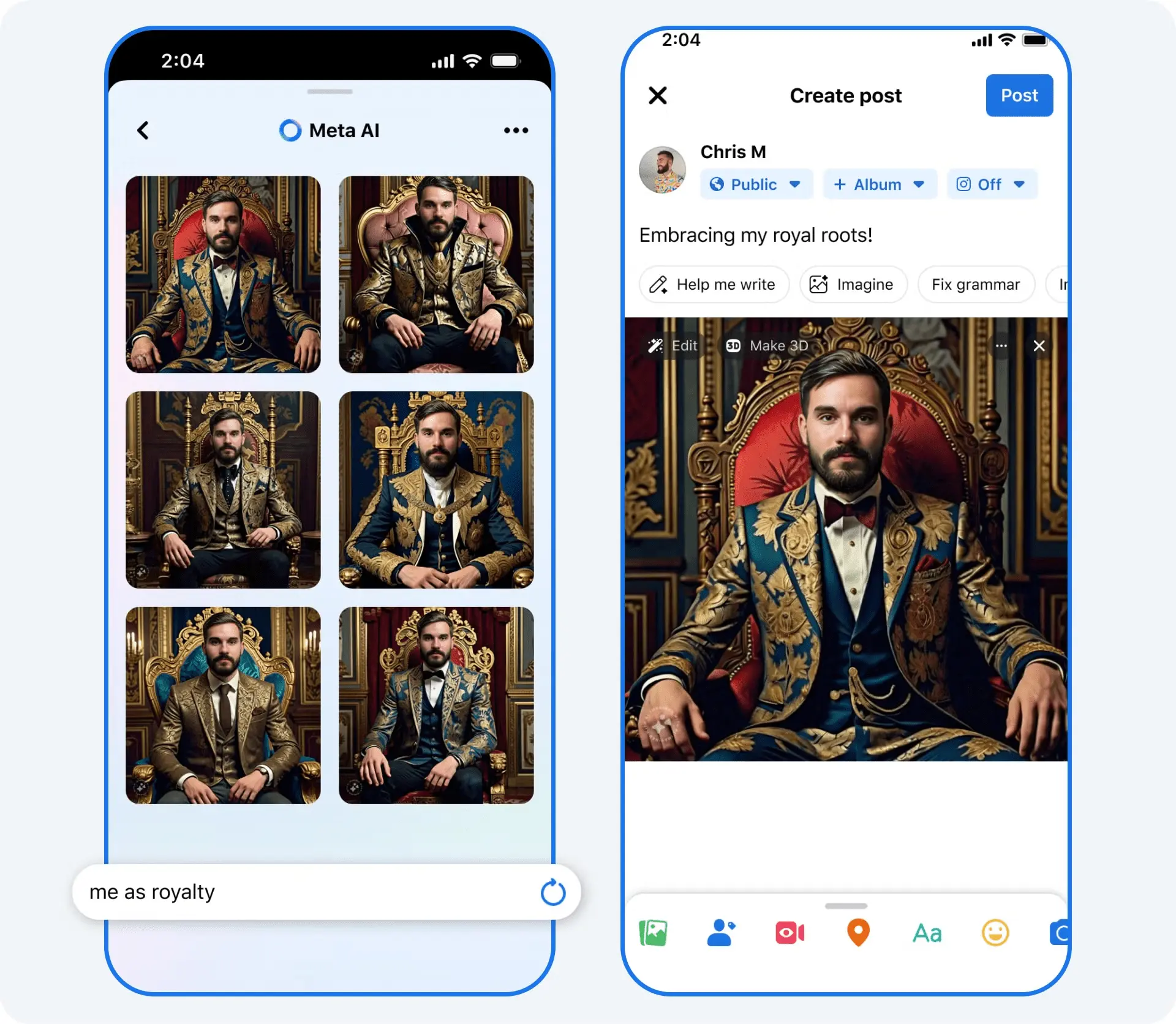

Meta AI 的 Imagine 功能:可以在动态消息、故事和 Facebook 头像生成自己的虚拟形象,而且发布的时候 AI 会帮你生成标题和介绍。

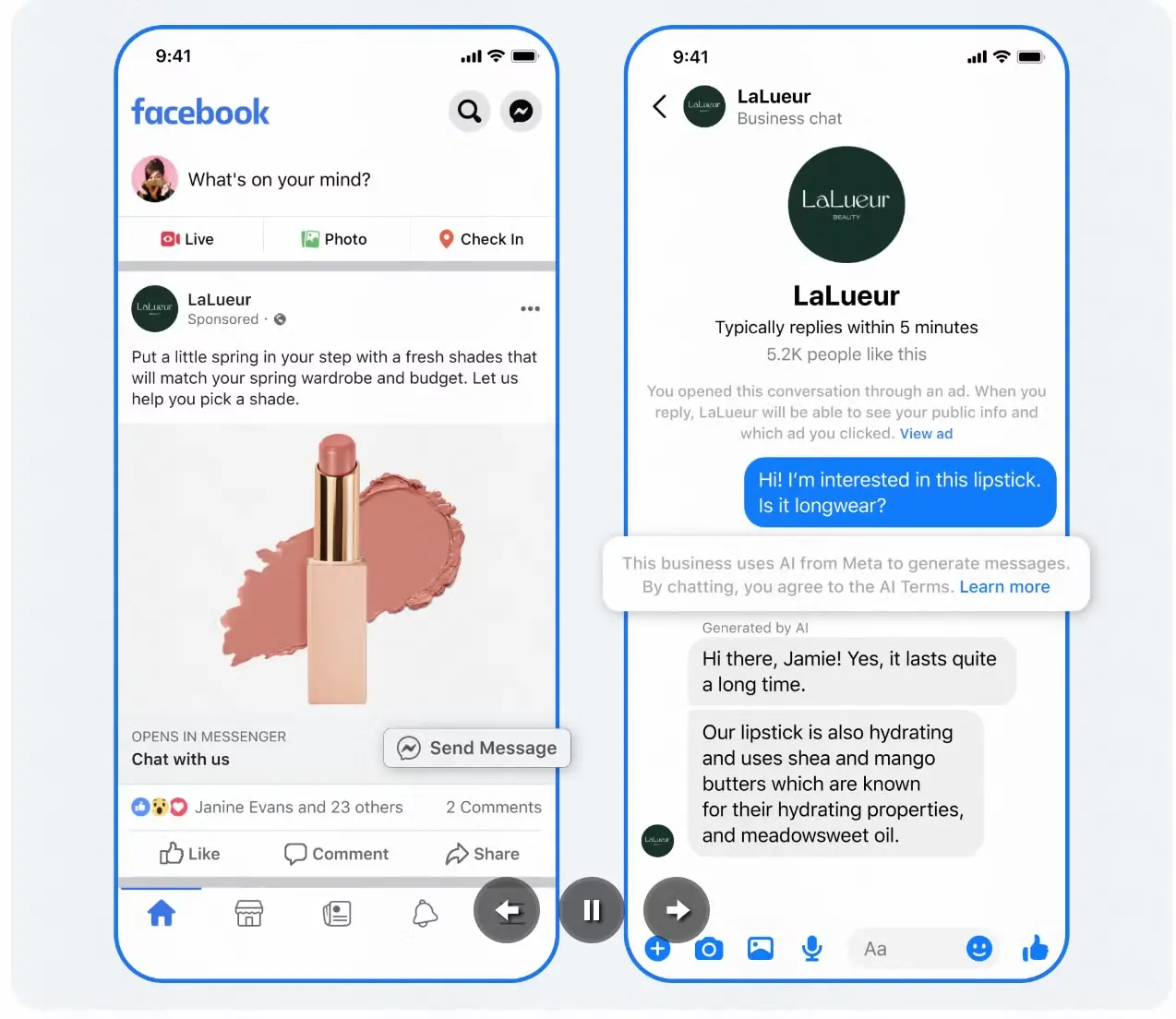

AI 广告:雇主用生成式 AI 广告工具创建了 1500 个广告,平均点击率比未使用这些功能的广告活动高出 11%,转化率高出 7.6%。

硬件

Orion 这个眼镜确实离谱,解决了现在 AR 设备几个重要的问题,操控精细度、佩戴舒适度和计算单元的链接问题。

Orion 是这个发布会的重头戏,小扎说这是世界上最先进的眼镜。

这玩意功能可以当成一个加强版的 Vision Pro,但是观感、触感和重量跟普通眼镜一样。

Orion的硬件分为三个部分:眼镜本身;一个用于控制眼镜的“神经腕带”;以及一个无线计算器,类似于手机的大电池包。眼镜不需要手机或笔记本电脑来工作。

通过眼动追踪、手动追踪、语音和神经腕带组合控制眼镜。

神经腕带看起来类似于没有屏幕的 Fitbit。它由高性能纺织材料制成,并使用肌电图(EMG)来解读与手势相关的神经信号。这些信号在毫秒内被转换为输入。

同时 Meta AI 软件也支持在 Orion 中使用,可以进行免提视频通话,与朋友和家人实时交流,还可以通过 WhatsApp 和 Messenger 保持联系,查看和发送消息。

Orion 目前是完整版本但是他们不会公开销售,接下来会专注优化增强现实显示质量、设备体积、降低成本。

这块比苹果稳妥多了,虽然能力比 Vision Pro 强很多,但是依然没有贸然推向市场。

雷朋 Meta眼镜也发布了更新功能:

- 重点是增加实时 AI 视频处理,这让你可以向雷朋 Meta 眼镜询问它所看到的事物。

- 还将获得类似智能手机的提醒功能;

- 实时语言翻译,支持英语与法语、意大利语或西班牙语之间的翻译;

- 并与亚马逊音乐、Audible 和 iHeart Radio 等音乐流媒体应用程序完全整合。

Quest 3S发布:

- 128GB 版本起价为 299 美元,256GB 版本为 399 美元。

- Quest 3 的更便宜替代品

- 完全与现有的 Quest 应用和游戏库兼容。

基本就是这些内容,我觉得最重要的就是小扎寄托在 AI 和 AR 设备结合抢夺下一代平台入口的决心。

在核心产品流程中主动插入 AI 生成内容来消费非常激进,其他类似的公司都不敢做这个决定。

Orion除了价格之外基本摸到了可以大规模使用和替代手机的门槛了。想先买个雷朋 Meta 太阳镜试试。